What is Semantic Dependency Parsing?

from reference | data and tool

介绍

语义依存分析(Semantic Dependency Parsing, SDP),通过树形(tree-shape)依存关系研究句子中的“深层”语义关系。换句话说,SDP是用于分析汉语句子的图结构语义表示

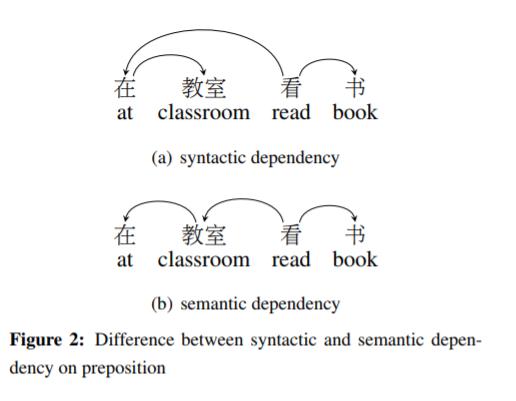

不同于传统的树形句法依存(syntactic dependency),每一个head-dependent弧都具有一个语义关系,但没有语法关系。因此,语义依存分析结果可以用来直接回答问题,比如谁在何时何地对谁做了什么;句法依存分析结果是定义在一个句子的所有单词上的连接树和特定于语言的语法函数,但在许多情况下不能回答问题。

取自HIT的Task 9: Chinese Semantic Dependency Parsing

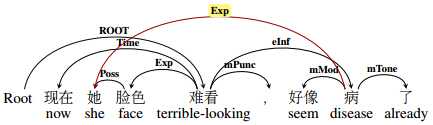

然而,在meaning-text语言学理论中,自然语言描述的理论框架( ˇ Zolkovskij and Mel’ˇcuk, 1967),有人说,在某些情况下,树不足以表达句子的全部意思,这一点在HIT的语料库标注实践中得到了不容置疑的证明。这一次,我们不仅根据汉语语言知识改进了汉语中通俗易懂的意义表示以达到减少语义关系的模糊性或模糊边界,我们还将依存结构扩展到符合汉语特点的有向无环图。因为汉语是一种语序灵活的意合(parataxis)语言,表面词汇中隐藏着丰富的潜在信息。例子如下:

“她”是“脸色”的argument(论元),同时也是“病”的论元。

依存分析领域的研究人员认识到,限制在树结构中的依存分析仍然过于浅显。因此,他们在SemEval 2014 (Oepen et al., 2014)和SemEval 2015的task 8中探索了树结构之外的语义信息。它们提供的数据与我们将要提供的数据结构类似,但是语义表示系统是不同的。我们再次提出这项任务是为了促进对汉语句子的深入理解的研究,我们认为,在数据驱动的统计依赖分析中,有必要利用免费的、注释良好的语料库作为公共测试平台来促进研究

数据介绍

种类丰富的文本具有不同的语言属性和不同的交流目的。

data format

任务描述

给定一个完整的句子,语义依存分析(SDP)的目的是确定语义上相互关联的所有单词对,并为其分配特定的预定义的语义关系。语义依存分析是通过一组依存词对及其对应的依存关系来表示句子的意义。这个过程不受句法变化的影响。

汉语语义依存图的结构

通过语义依存图来表示句子的意义,其中包含了所有具有直接语义关系的词对之间的依存关系。

- 谓元(Predicates)包括大多数谓语成分(即大多数是动词,也有名词和形容词)

- 论元(Arguments)被定义为真实场景中与某个谓元对应的所有可能的参与者(例如与“吃”相关的场景中的食客、食物、工具、地点、时间)

构建依存弧的一个原则是优先在实词(content words)中查找predicates的arguments,因为它们是与谓元直接相关的论元。

与句法依存不同的是,句法依存在谓元(predicate)及其“real arguments”之间插入非实词(non-content words)。

由于词与词之间关系表示的完整性,有的词与多个词存在关系(有的词有多个子词,有的词有多个父词),最终形成直接的无环图(acyclic graphs)。

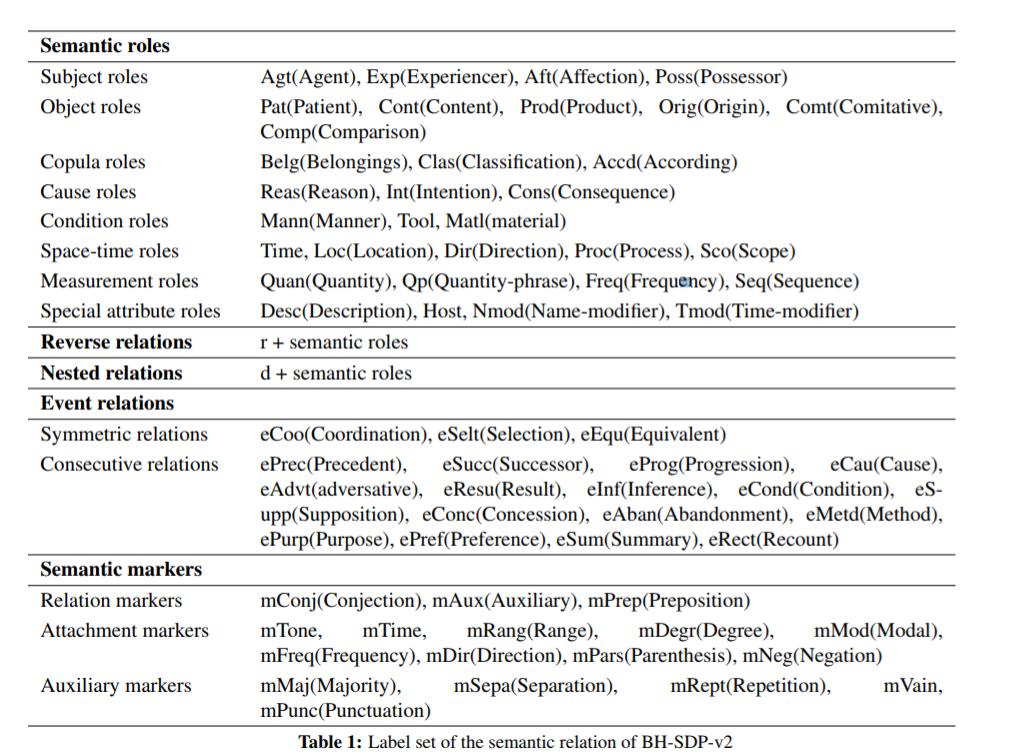

语义依存关系

评估方法

将预测的依存关系(predicate-role-argument 三元组,其中一些包含整个句子的根)与人工标注的依存关系(它们被视为gold依存关系)进行比较。

评估指标是基于两个粒度:依存弧(dependency arc)和完整的句子。与预测的依存关系相关的标记和未标记的精确度(precision)和召回率(recall)将用作评估指标。

The evaluate measures are on two granularity, dependency arc and the complete sentence. Labeled and unlabeled precision and recall with respect to predicted dependencies will be used as evaluation measures

non-local dependencies: 将这些依存弧称为使依存树折叠的非局部依存弧。(we call these dependency arcs making dependency trees collapsed non-local ones, following Sun et al. (2014))

在SemEval 2014的Task8之后,在下面以及其他与任务相关的上下文中,将把这些度量标准缩写为:

a. labeled precision,recall, F1 和非局部依存的recall【NLR】:LP, LR, LF, NLR

b. unlabeled precision, recall, F1 和非局部依存的recall【NUR】:UP, UR, UF, NUR

c. labeled and unlabeled exact match(精确匹配):LM,UM

- Labeled precision (LP), recall (LR), F1 (LR) and recall for non-local dependencies (NLR);

- Unlabeled precision (UP), recall (UR), F1 (UF) and recall for non-local dependencies (NUR);

- Labeled and unlabeled exact match (LM, UM)

相关文献

- Aleksandr ˇ Zolkovskij and Igor A. Mel’ˇcuk. 1967. O sisteme semantiˇceskogo sinteza. ii: Pravila preobrazovanija [on a system of semantic synthesis (of texts). ii: Paraphrasing rules]. In Nauˇcno-texniˇceskaja informacija 2, Informacionnye processy i sistemy, pages 17–27.

- Nianwen Xue and Martha Palmer. 2003. Annotating the propositions in the Penn Chinese Treebank. Proceedings of the second SIGHAN workshop on Chinese language processing -, 17:47–54.

- Stephan Oepen, Marco Kuhlmann, Yusuke Miyao, Daniel Zeman, Dan Flickinger, Jan Hajiˇc, Angelina Ivanova, and Yi Zhang. 2014. SemEval 2014 The 8th International Workshop on Semantic Evaluation Proceedings of the Workshop Dublin , Ireland. In Proc. of SemEval.

- Wanxiang Che, Meishan Zhang, Yanqiu Shao and Ting Liu. 2012. SemEval-2012 Task 5 : Chinese Semantic Dependency Parsing. In Proceedings of the First Joint Conference on Lexical and Computational Semantics-Volume 1: Proceedings of the main conference and the shared task, and Volume 2: Proceedings of the Sixth International Workshop on Semantic Evaluation, pages 378–384.

- Weiwei Sun, Yantao Du, Xin Kou, Shuoyang Ding, and Xiaojun Wan. 2014. Grammatical relations in Chinese: Gb-ground extraction and data-driven parsing. In Proceedings of the 52nd Annual Meeting of the Association for Computational Linguistics (Volume 1: Long Papers), pages 446–456, Baltimore, Maryland, June. Association for Computational Linguistics.

- Xiao Fan. 1998. The Sentence Types of Chinese. Shanghai Publishing House.